ローカルLLM構築:Hugging Faceからモデルをプルしてみる。そしてSLMを試す

n8nのワークフロー作りで、自分の使い方に合わせた設計を考えていたら。

考えているだけになりました。

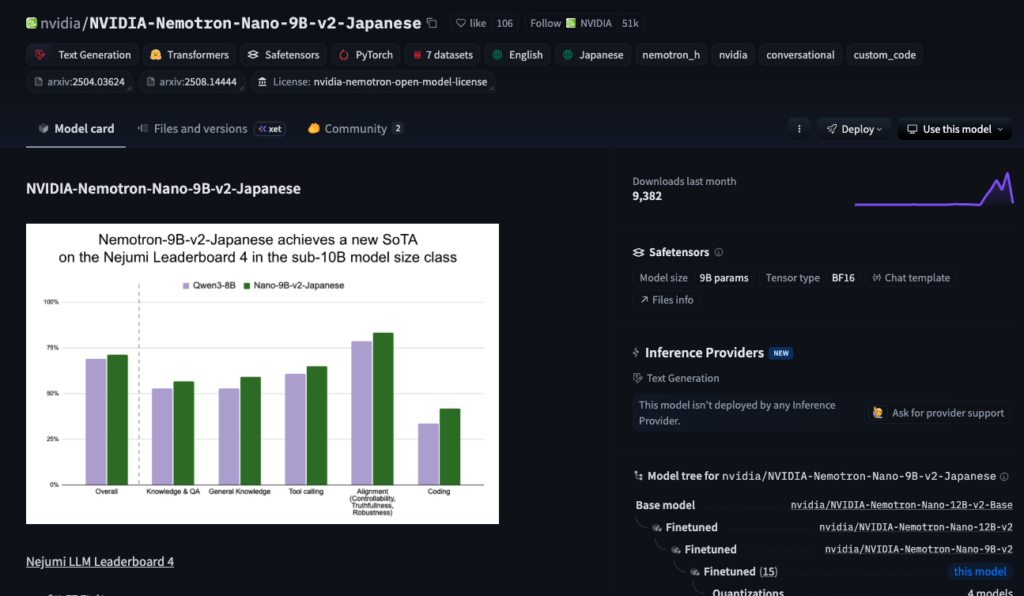

そんな中、小型モデルの高性能なモデルがNVIDIAから公開されたという情報が。

記事によると、日本語性能を測っている「ねじゅみリーダーボード」でもかなり良い数値だそうです。

気になるなぁと思いつつ。

そういえば、Hugging Faceからモデルの導入はまだしてなかったなと。

試して見ることにしました。

Open WebUIにHugging Faceからモデルをプルする

ローカルでstable diffusionを構築して依頼の、Hugging Faceの訪問です。

Dockerで構築してOpen WebUIと連携する前は、コマンドから動かしていたのがすでに懐かしい。

Open WebUIのモデル管理から、モデルをプルできるのかと思っていたら。

Hugging FaceからOllamaにプルして、それをOpen WebUIで利用するという流れのようです。

今回プルするモデルは、上記の記事の中にあったnvidia/NVIDIA-Nemotron-Nano-9B-v2-Japanese。

ありました。

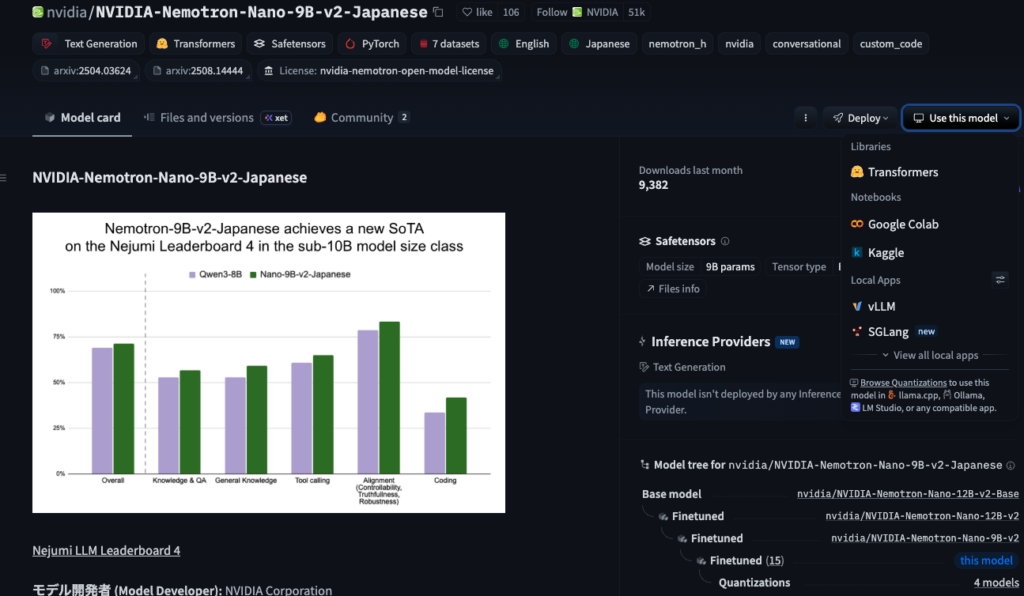

Ollamaにプルするコマンドは、右上の「Use this model」から「Ollama」を選択すれば取得できるんですがー。

・・・ない。

どうもGGUF形式のものが用意されてないようです。

GGUFファイルは量子化済みファイルのことで。

元のモデルを軽量化し、ローカルマシンでも動きやすくしているものだそうで。

Ollamaと同じく生成AIインターフェースである、llama.cppで使用するファイルとのこと。

詳しくは、以下のQiita記事がわかりやすかったので、ご覧ください。

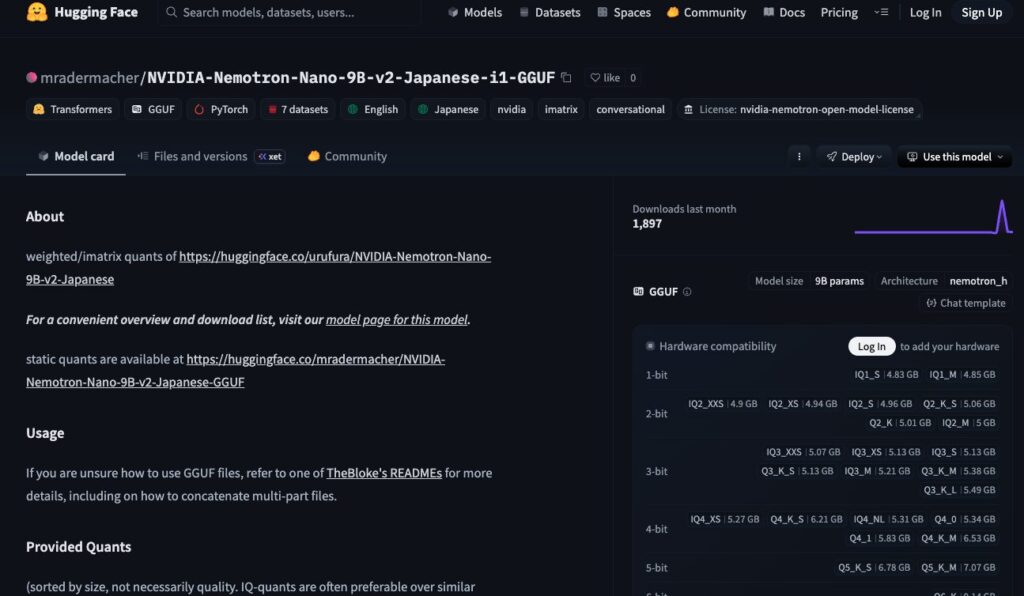

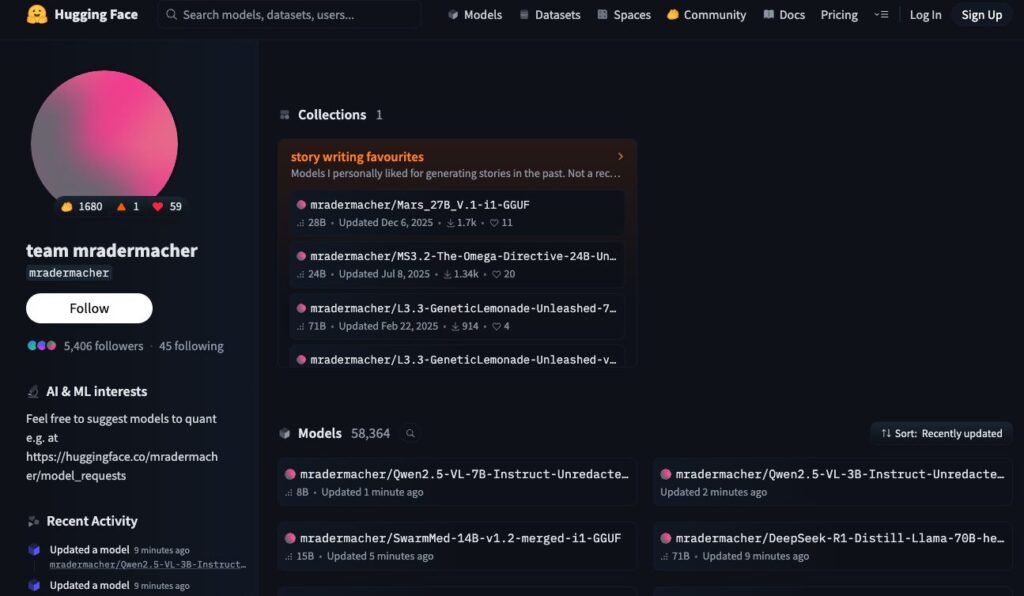

GGUF形式のものがあるか少し探してみたら、ありました。

冒頭に「mradermacher」とついていますが。

これは団体名か個人名からしく、量子化されていないモデルを有志でモデル化してくれているそうです。

ありがたい。

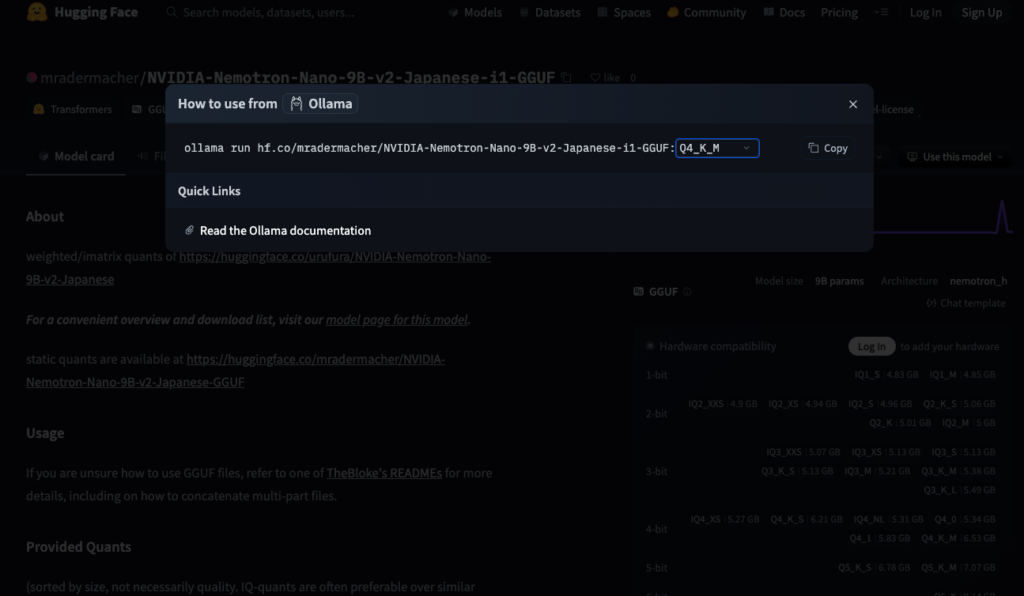

先程のコマンドを入手するところで、「Ollama」があるので選択するとコマンドが表示されます。

末尾のセレクトBOXにある「Q4_K_M」で、量子化タイプを選択できます。

デフォルトが最も利用されているものみたいなので、私はそのまま。

マシンに余裕があれば「Q6_K」にしても良いかもしれないですね。

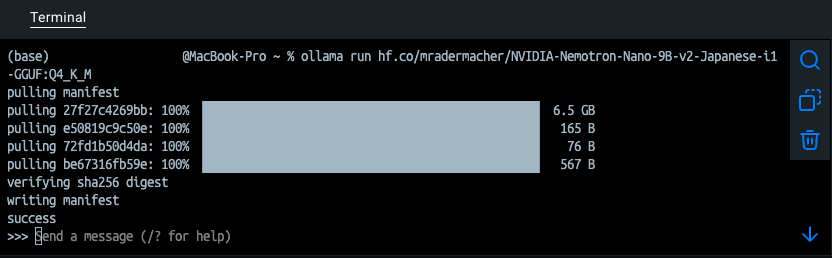

このコマンドをコピーして、ターミナルで走らせます。

無事プルできました。

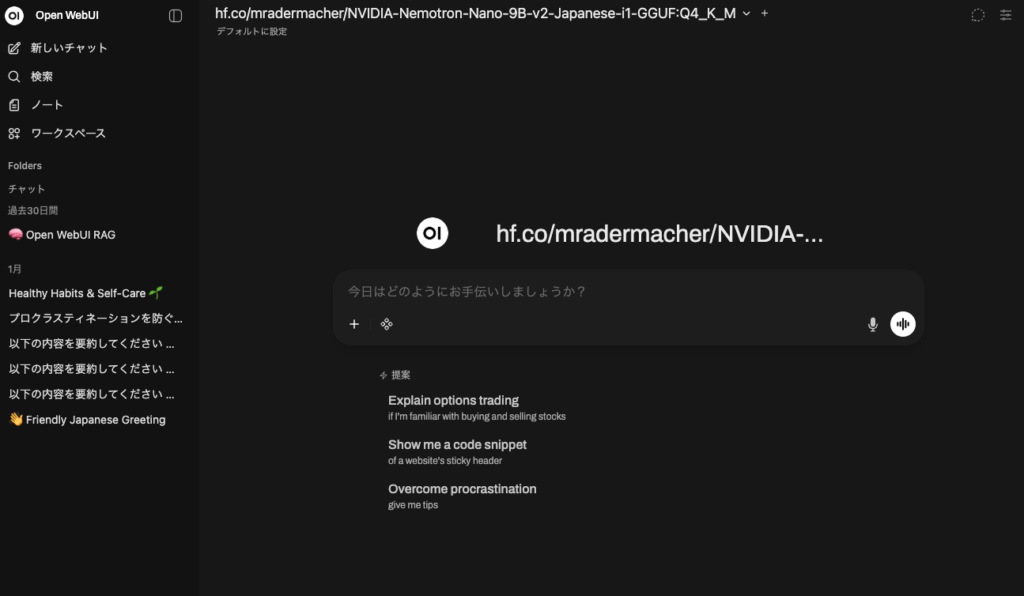

この状態でOpen WebUIを立ち上げると、使用できるモデルに追加されています。

これでHugging Faceにあるモデルも、GGUF版とはなりますが、Open WebUIで使えます。

ここ最近ではセキュリティ上危険なモデルもあるみたいなので、プルする場合は提供者の情報などは確認するようにした方が良さそうですね。

mradermacher/NVIDIA-Nemotron-Nano-9B-v2-Japanese-i1-GGUFを試してみる

では、早速mradermacher/NVIDIA-Nemotron-Nano-9B-v2-Japanese-i1-GGUFを試してみます。

以前に普段遣いのモデルを選んだのと同じ方法で進めます。

まずは、文章の要約です。

前回と同じく当ブログの記事の内容を要約してもらいました。

ユは安全確認済み? The user wants response in Japanese only. No extra formatting unless asked. Provide answer without markdown. Should be plain text.

先延ばしを防ぎ、目標を達成するための具体的なアプローチをまとめます。

1. スモールステップで「変化」を小さく

・脳が嫌うのは大きな変化。勉強やタスクの開始を「椅子に座る」「参考書を開く」など日常行動レベルまで細分化。

・「思うだけ」ではなく、実際に体を動かす習慣をつけると自然と続きます。2. 準備をプログラムやツールで自動化

・生成AIを活用して情報収集・要約・分析を代行。

・Power AutomateなどでExcel操作やデータ整理をルーティン化し、手間を削減。3. 習慣化のための仕組みづくり

・スマホアラームや目につく場所へのメモで時間管理。

・一度習慣が定着したら、気分転換として「散歩5分」などの余裕を持たせる。4. 過去の成功体験を再現する要素を抽出

・自分に合った「眠くならない時間帯」「協力者への声かけ方法」など、目標達成に有効なパターンを記録。

・苦手分野はツールや周囲の支援で補い、得意分野を活かして集中。5. 自己効力感を高める好循環をつくる

・「小さな成功」を積み重ねて自信を育む。

・達成した記録を可視化し、次回へのモチベーション源とする。これらを組み合わせることで、脳の本能やリソース制約を考慮した「先延ばし防止の仕組み」が完成します。無理なく継続できるよう、まずは1つずつ実践してみてください。

思考内容を表示するようにしていたのを忘れて、バグったかと思いました。

要点をうまくまとめてくれていると思います。

内容よりも、応答の速さに驚きました。

プロンプトを投げた後、少し待つようかなと思ってたんですが。

すぐに出力が返ってきてました。

この要約を元にして、前回と同じプロンプトで紹介記事の構成案を提案してもらうと。

We need to propose a blog article structure for introducing the content (the previous answer about overcoming procrastination) to a salaryman audience. Must be in Japanese, no extra formatting unless asked; no markdown. Provide structure proposal: sections, headings, maybe bullet points but plain text. Avoid bold/italic? The user didn’t ask for markdown, so we should avoid markdown formatting like **. Use simple line breaks and maybe indentation with spaces or hyphens. Provide clear outline.

We must follow instructions: respond in Japanese only. No extra commentary beyond requested response. So just give the structure proposal.

サラリーマン向けブログ記事の構成提案

- 見出し(タイトル)

「忙しいビジネスマンが陥りやすい『後回し』の実態と、今日から使える3ステップ解決法」- 導入部

・サラリーマンが抱えやすい時間不足の現状を短く描写。

・「あの重要なプロジェクトもメール対応で先延ばし…」という身近な例を提示。

・本記事で解説する「3ステップ」に触れ、即実践できるポイントを期待感を持って伝える。- なぜサラリーマンは先延ばしになりやすいのか?

・業務の多様化とスイッチングコストが脳を混乱させる仕組み。

・「締め切り直前」のプレッシャーで逆に作業効率が下がる現象(心理的負荷)。

・定時退社や残業規制による「時間制約」が逆説的に行動を遅らせる。- 具体的な解決ステップ①:タスクを1アクションに分解する

・例:「報告書作成」→「Excelのデータをコピーして貼り付ける」「グラフを挿入する」など。

・「立ち上がって椅子から立ち上がる」という動作レベルまで細分化するメリットを解説。- 具体的な解決ステップ②:ツールとルーティンで自動化・可視化

・スマートフォンの「タイマー+アラーム」活用術。

・Power AutomateやNotionテンプレートで定例業務を繰り返し実行する方法。

・「見える化ボード」をデスク横に貼ることで進捗を意識させる技法。- 具体的な解決ステップ③:小さな成功体験を記録して自信を育む

・1日の終わりに「今日できたこと」を1つだけメモする習慣。

・達成記録をカレンダーで色分けし、月間の積み重ねを可視化するコツ。- サラリーマンが実践しやすい応用例

・朝の10分「準備モード」で翌日のタスクを先回りしてチェック。

・会議後の5分間「振り返りメモ」で次のアクションを明確化。

・チーム内での共有ノートで全員が同じ基準で進捗を把握し、個人の負担を軽減。- 結び:今日から始める1つの行動

・「本日中に1タスクを1アクションまで分解してみる」という具体的なチャレンジ提案。

・次回記事で「自動化テンプレートのダウンロード方法」や「チーム内導入事例」を紹介する予告。

THE提案ですね。

余計なアウトプットはありません。

少し寂しさを感じるくらいに、生成AIとやり取りをしている私ですが。

記事の下書き・・・筋書きですね。

十分使えるレベルです。

容量が小さい分で勝っているか

以前比較したローカルモデルを踏まえて考えると。

内容としては、gpt-ossからすると物足りなく、Gemma3とは同程度というところでしょうか。

これなら、gpt-ossかとも思いましたが。

利点はモデルの大きさですね。

gpt-ossは20Bモデルで、Gemma3は12Bモデルを使用しています。

今回のNVIDIAモデルは9Bです。

これが動作の軽量さを実現していると考えると、NVIDIAの方が使いやすいですね。

ローカルの問題はやはり動作ですからねぇ。

何度か経験がありますが。

最初の方はサクサクでも、だんだんと悪くなる場合もありますし。

小さい容量で高性能なものをローカルに積める方が、普段遣いとしては良いです。

もう少し機能を追加したら

急遽でしたが、Hugging Faceからのモデルの追加とNVIDIAのモデルのテストをしてみました。

モデルばかり増やしてもあれなので、もう少し機能を追加したら、メインで使うようにしてみようかと思います。

NVIDIAは2024年9月までのデータで学習しているそうなので。

うーん、ローカルの問題はやはりここらへんですよねぇ。

まぁ最新の情報を扱うように設計するのも、ローカルは少し違うような気がしなくもないんですけどね。

まずは、途中になっているn8nの設定の完了を目指します。

このブログや記事の内容について、疑問に思っている事はありますか?

もしあれば、どんなことでも構いませんので、コメントを残していただくか、問い合わせフォームよりご連絡ください。

はじめまして、「ぽんぞう@勉強中」です。

小企業に一人情報部員として働いている40代のおじさんです。IT技術での課題解決を仕事にしていますが、それだけでは解決できない問題にも直面。テクノロジーと心の両面から寄り添えるブログでありたいと、日々運営しています。詳しくはプロフィールページへ!

ディスカッション

コメント一覧

まだ、コメントがありません